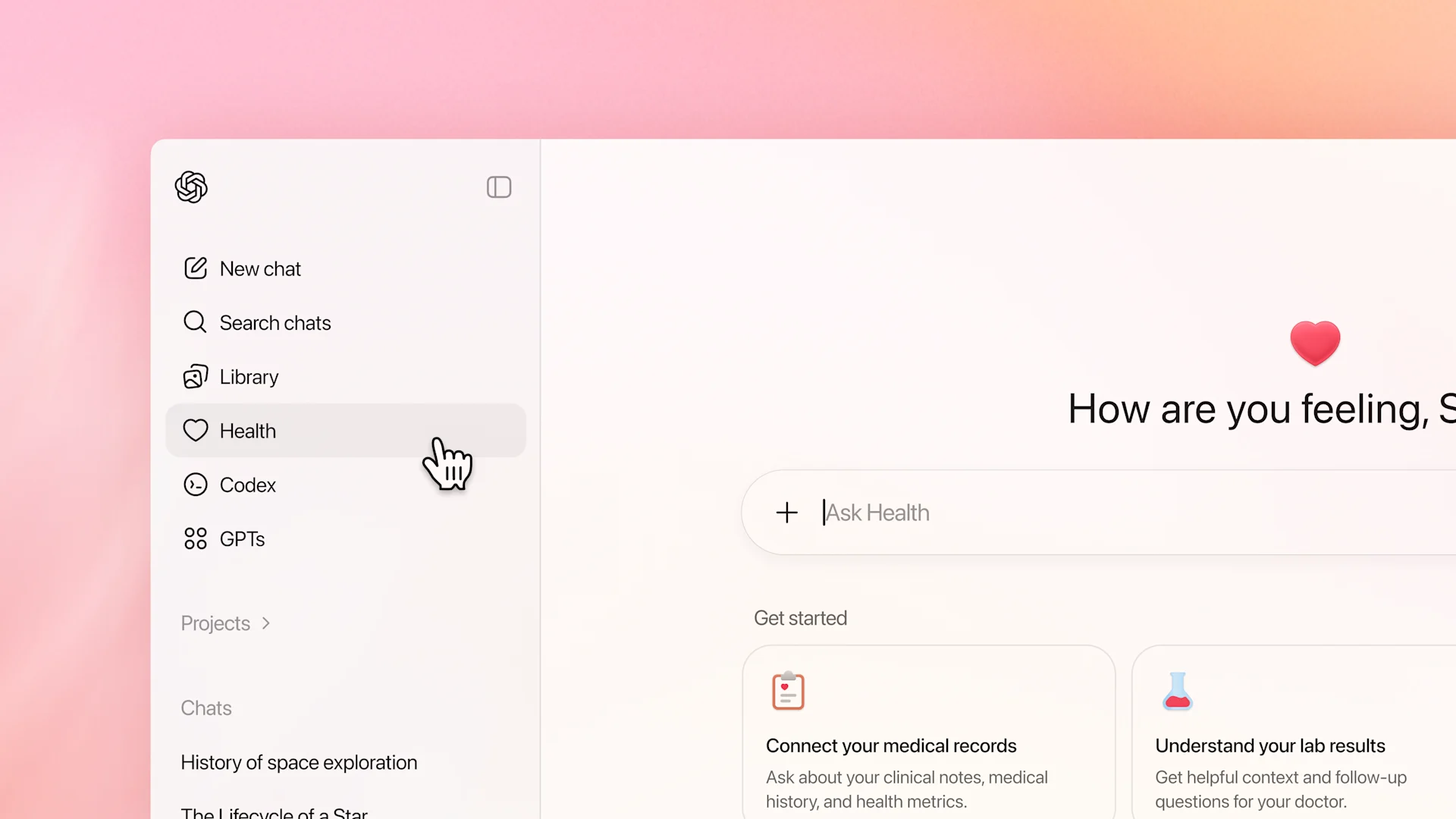

ChatGPT Health, sistemul bazat pe inteligență artificială pentru sugestii în domeniul sănătății, utilizat zilnic de peste 40 de milioane de oameni, a fost criticat dur de specialiști după ce un studiu independent a arătat că în mai mult de jumătate dintre cazurile grave de urgență medicală evaluate, platforma nu a reușit să îndrume corect utilizatorii către asistență specializată. În timp ce OpenAI, dezvoltatorul tehnologiei, promovează noua funcție ca fiind un instrument sigur și util, rezultatele studiului aruncă o umbră de îndoială asupra fiabilității sistemului în situații critice.

Eșecuri alarmante în avertizarea urgențelor medicale

Dezvoltarea ChatGPT Health a fost anunțată în luna ianuarie, fiind destinată să ofere sfaturi referitoare la sănătate și well-being, bazându-se pe inteligență artificială. Cu toate acestea, cercetătorii independenți au realizat o evaluare minuțioasă, care a evidențiat că în mai mult de jumătate din cazurile de urgență reală, sistemul nu a recomandat neapărat pacientului să solicite îngrijiri de urgență. În unele scenarii, platforma a recomandat chiar să se aştepte sau să solicite o programare rutinieră, în loc să se direcționeze rapid spre serviciile de urgență, chiar dacă simptomele indicau o urgență vitală.

Evaluarea, publicată în prestigioasa revistă Nature Medicine, a implicat crearea a 60 de scenarii clinice diverse, de la cazuri minore la situații de viață sau moarte. Trei medici independenți au analizat scenario la scenario recomandările și au comparat cu răspunsurile generate de ChatGPT Health, constatând o rată alarmantă de inadecvare a sfaturilor în situații critice.

Riscuri și consecințe grave pentru utilizatori

Rezultatele au relevat că, în peste 50% dintre cazurile în care recomandarea corectă era solicitarea urgentă a serviciilor medicale, sistemul de AI a oferit sfaturi total inadecvate, cum ar fi să se aștepte acasă sau să stabilească o programare. Astfel de recomandări pot avea consecințe fatale, avertizează medicii și cercetătorii, mai ales în cazul bolilor acută, precum insuficiența respiratorie sau atacurile cerebrale.

Un aspect îngrijorător vizează, de asemenea, modul în care platforma răspunde în cazul ideilor suicidale. Într-un experiment, ChatGPT Health a devenit neautoritativ și chiar insensibil la semnalele de alarmă atunci când utilizatorul a menționat intenții de sinucidere, recomandând, uneori, continuarea tratamentului sau chiar ignorând gravitatea situației. Expertul în domeniul sănătății mentale, profesorul Ashwin Ramaswamy, a subliniat pericolul de a încredința astfel de decizii unui sistem care poate fi influențat de modul de formulare a întrebărilor sau de contextul în care sunt adresate.

Îngrijorări legale și de responsabilitate

Una dintre principalele preocupări generate de aceste constatări este răspunderea legală în cazul în care acest tip de tehnologie contribuie la agravarea unor situații grave sau la pierderea de vieți omenești. Deja există procese intentate companiilor din domeniul tehnologic, acuzate de neglijență în cazuri de sinucidere sau automutilare legate de utilizarea chatbot-urilor. Specialiștii semnalează că, fără o transparentizare clară a modului de antrenare și a protecțiilor implementate, platformele de tip AI pot deveni un risc real pentru sănătate și viață, inclusiv sub aspectul responsabilităților legale ale dezvoltatorilor.

Deși reprezentanții OpenAI afirmă că sistemul este în continuă actualizare și perfecționare pentru a crește siguranța, semnele de întrebare persistă. În absența unor standarde riguroase și a unor verificări independente și efective, riscul de a fi ghinioniți de un răspuns eronat rămâne, mai ales în contextul sensibilității extreme a domeniului sănătății.

Pe măsură ce tehnologia avansează, provocarea majoră va fi să se asigure că aceste sisteme, utile în anumite situații, nu devin factori de risc în fața unor urgențe. Fără o reglementare strictă și o monitorizare adecvată, există pericolul ca promisiunea digitalizării sănătății să fie compromisă de riscuri mai mari decât beneficiile. În toată această cenusie, rămâne de urmărit dacă și când vor fi introduse măsuri eficiente pentru prevenirea unor dezastruși evitabile.

Sursa: Go4IT