Nvidia își reafirmă leadership-ul în domeniul inteligenței artificiale, anunțând o estimare de peste un trilion de dolari în comenzi pentru noile sale sisteme Blackwell și Vera Rubin până în 2027. Anunțul a fost făcut de Jensen Huang, CEO-ul companiei, în cadrul conferinței anuale pentru dezvoltatori GTC 2026, desfășurată la San Jose. În contextul în care industria AI înregistrează o creștere explozivă și cererea pentru putere de calcul devine tot mai acută, Nvidia investește în tehnologii avansate care să susțină noile aplicații, de la modele de limbaj sofisticate la agenti inteligenți autonomi.

Proiecții de creștere și impact asupra pieței globale de hardware pentru AI

Până în prezent, estimările Nvidia erau mai modeste, compania anticipând oportunități de venituri în jur de 500 de miliarde de dolari din generațiile de cipuri Blackwell și Rubin. Cu toate acestea, ritmul rapid al cererii și evoluția aplicațiilor AI, mai ales în domenii precum agentic AI — un concept emergent ce presupune crearea de agenți software capabili să execute sarcini complexe și să ia decizii autonome — indică faptul că piața poate ajunge la niveluri mult mai mari. Declarațiile lui Huang au avut un efect imediat asupra burselor: acțiunile Nvidia au crescut luni cu circa 2%, investitorii fiind încrezători în continuarea creșterii spectaculoase a companiei, care acum are o capitalizare de piață impresionantă de aproximativ 4,5 trilioane de dolari.

Noile platforme pentru centre de date și eficiența energetică

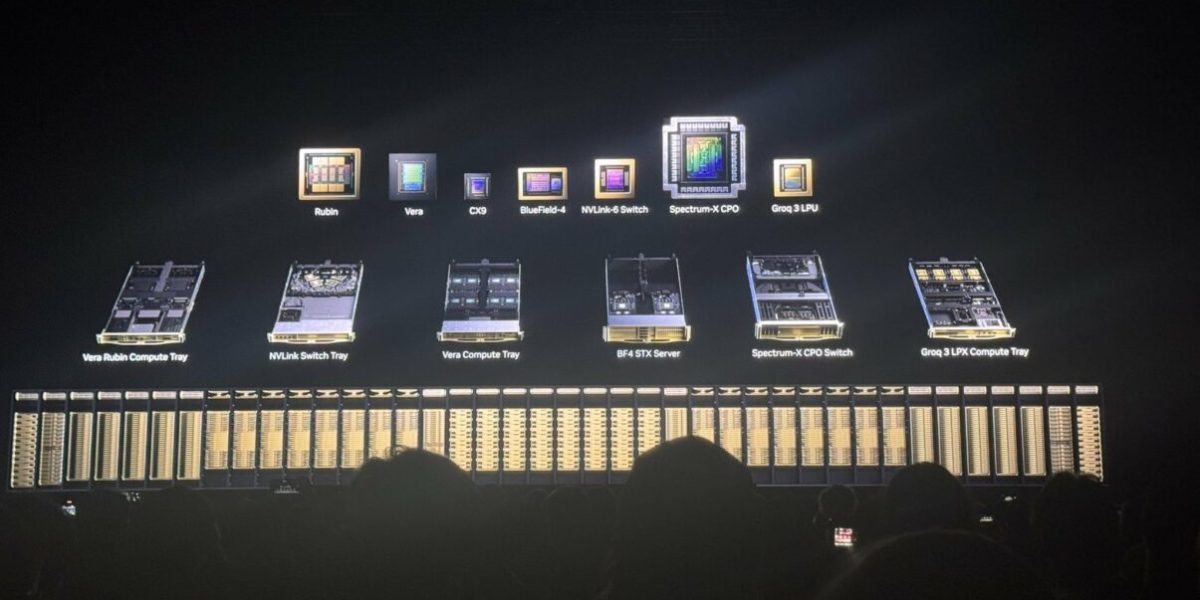

Cea mai recentă platformă, Vera Rubin, care urmează să fie lansată avant la lettre, promite o performanță de până la de zece ori mai bună per watt comparativ cu predecesorul său, Grace Blackwell. Într-un moment în care centrele de date pentru AI consumă din ce în ce mai multă energie, această diferență de eficiență poate fi decisivă pentru sustenabilitatea și extinderea utilizării tehnologiilor AI la nivel global. Mai mult, Huang a prezentat și o unitate de procesare a limbajului dezvoltată de startup-ul Groq, preluată de Nvidia în decembrie anul trecut într-o tranzacție estimată la circa 20 de miliarde de dolari. Cipul Groq 3 LPU (Language Processing Unit) va accelera semnificativ procesarea modelelor de limbaj, funcționând în tandem cu GPU-urile Nvidia pentru a obține rezultate mai rapide și mai eficiente.

Inovații pentru performanță și densitate în centrele de date

Pe lângă noile cipuri, Nvidia pregătește un rack dedicat acceleratoarelor Groq, conceput pentru centrele de date. Acesta va include 256 de unități LPU și va putea funcționa împreună cu platforma Vera Rubin, asigurând o creștere de până la 35 de ori a performanței în generarea și procesarea „tokenilor per watt”, un indicator cheie al eficienței AI. În plus, Huang a prezentat un prototip al arhitecturii Kyber, un sistem de servere pentru centre de date ce va integra 144 de GPU-uri montate vertical, pentru a crește densitatea și a reduce latența. Acest sistem advanced va fi inclus în platforma Vera Rubin Ultra, programată pentru lansare în 2027, urmând să redefinească dinamicile infrastructurii de AI de mâine.

Pe măsură ce tehnologia avansează, Nvidia pare să deslusească strategiile pentru a susține o în continuare explozie a inovației în domeniul inteligenței artificiale, pregătind terenul pentru aplicații și sisteme capabile să răspundă noilor provocări tehnologice și etice ale secolului XXI. Odată cu dezvoltările din centrul de cercetare și producție, se conturează deja anumite perspective optimiste legate de viitorul AI, unde puterea de calcul, eficiența energetică și inovația tehnologică vor fi cheile succesului.